HBM堆叠工艺深度解析:存储芯片为何成为AI算力新瓶颈

三年前,数据中心扩张遭遇的首要挑战是电力。如今,这一格局已被彻底打破。

时间回溯:瓶颈如何转移

2022年至2024年间,微软、谷歌、亚马逊等科技巨头在能源领域的布局令人瞩目。核电协议、风电场投资、清洁能源采购成为标配动作。彼时业界共识是:电力供应决定AI算力上限。

2025年3月24日,华盛顿HillandValleyForum论坛传来新信号。OpenAI首席运营官BradLightcap明确表态:"现在的瓶颈是存储,过去是电力。"这句话标志着认知拐点的到来。

关键节点:供需失衡数据实证

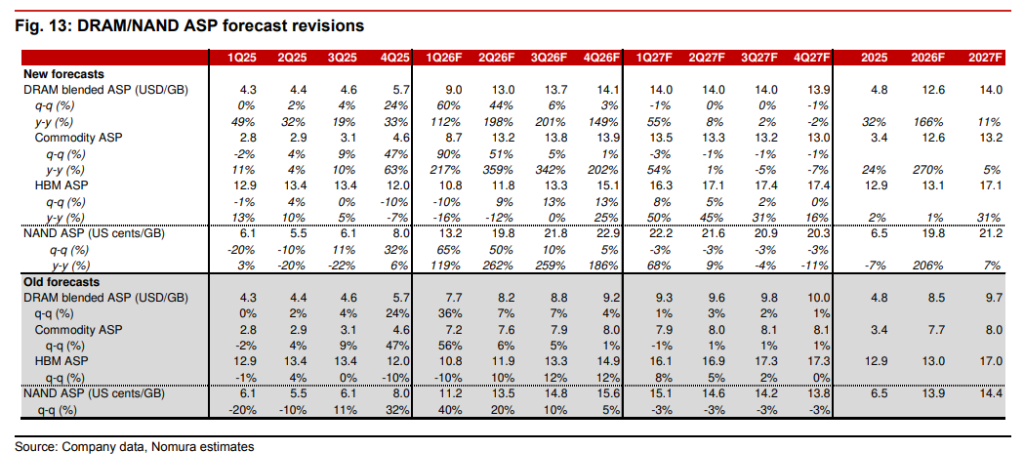

野村证券最新预测数据最具说服力。2026年Q2大宗DRAM价格将环比上涨51%,NAND上涨50%,较此前预测的6%和20%实现跨越式上调。这一涨幅背后是AI服务器对存储的海量吞噬。

对比数据揭示本质差异:AI服务器DRAM容量需求是传统服务器的3-5倍,NAND需求更是达到12倍。这意味着单位算力所需的存储资源呈指数级增长。

经验总结:HBM结构性短缺根因

产能瓶颈根源在于HBM生产复杂性。每颗HBM芯片由12-16层DRAM裸芯片堆叠构成,即将升级至20层。数千个硅通孔(TSV)必须实现精准对位连接,良率控制难度极大。

更为关键的是,HBM消耗的晶圆产能是标准DRAM的3倍以上。产能扩张需要时间:半导体级洁净室建设周期长达数年,单厂建筑投入20-30亿美元。三星、SK海力士、美光三大巨头同步扩产,新增产能最早也要到2027年下半年释放。

方法提炼:存储厂商应对策略

面对结构性短缺,行业正在经历商业模式根本转变。存储厂商与客户积极签订长期协议(LTA),包含预付款、容量保证和定价方案。行业从"现货驱动"向"长期规划驱动"转型。

美光FY2026Q2财报印证这一趋势:营收238.6亿美元,同比增长196.3%,非GAAP毛利率74.9%。更关键的是,2026年全年HBM产能已全部通过不可取消长期协议锁定,首个5年期LTA客户已签下。

应用指导:双重制约下的产业格局

存储瓶颈缓解之后,电力供应仍将是制约因素。Lightcap透露,OpenAI正与核聚变初创企业HelionEnergy洽谈合作,考虑引入包括核能在内的多元化电力来源。

结论清晰:存储决定短期算力芯片产出上限,能源决定芯片能否被部署运行。这种"双重制约"构成AI产业新现实。投资者和从业者需同时关注两大要素的供应动态,方能把握产业发展脉络。